“La bruttezza è meglio della bellezza. Dura più a lungo, e,

alla fine, la gravità ci prenderà tutti.”

Johnny Depp

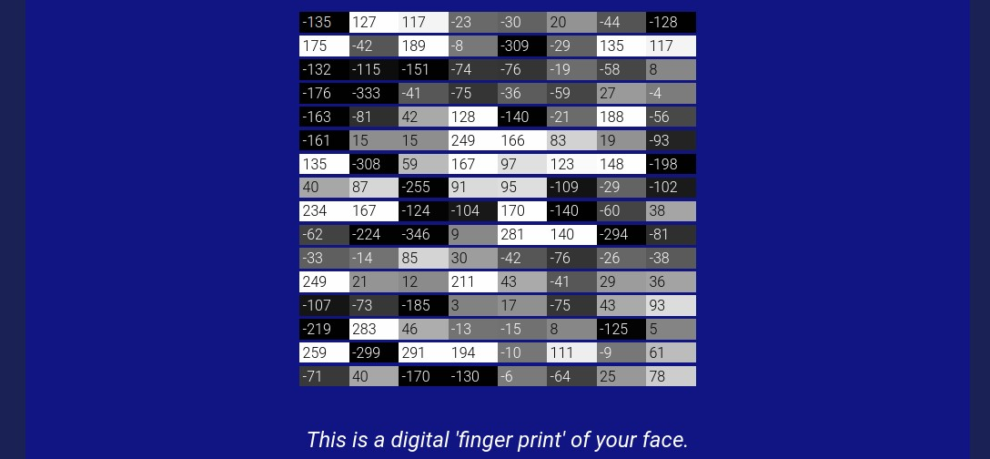

Attraverso la webcam del nostro PC o dello smartphone, un algoritmo ci dice quanto siamo belli, indovinerà la nostra età (presunta), il sesso e pure il BMI. Potete provarlo voi stessi, andando sul sito web “How normal am I?” e seguendo le semplici istruzioni (è necessario consentire l’accesso alla webcam, anche se nessun dato sarà trasferito sul server del progetto).

Supportato dalla comunità europea all’interno dell’iniziativa Sherpa, questo interessante e provocatorio progetto artistico di Tijmen Schep nato nell’ottobre 2020 ha come obiettivo quello di mostrare come gli algoritmi di riconoscimento facciale sono utilizzati per giudicare le persone:

[the project] shows how facial recognition algorithms are used to judge people. By taking a test, the documentary analyses and rates your face in terms of age, beauty, and gender. It also assesses your emotional state and estimates your BMI and life expectancy […] finally highlights the unreliability of facial recognition algorithms and the importance of safeguarding privacy, as a fundamental human right, and “our right to be different. You could say that privacy is a right to be imperfect”.“How Normal Am I?” nominated for best .eu website of the year

Non stupitevi se i dati rilevati non saranno corretti: lo scopo del progetto è proprio questo: dimostrare come la cieca fiducia nella tecnologia sia mal riposta e che, in certe situazioni, può essere molto pericolosa. Accettereste, ad esempio, di essere giudicati da un giudice virtuale che vi condanna o meno secondo algoritmi automatizzati, creati da terzi basandosi su un dataset di sentenze storiche? Oppure, affidare una diagnosi a un medico virtuale che risponde ai vostri sintomi basandosi esclusivamente sulle informazioni scientifiche usate per il training della sua IA? Personalmente, ho qualche riserva in merito.

Non dobbiamo mai dimenticare un aspetto della tecnologia: è stata creata, sviluppata, configurata da esseri umani. Con i loro bias, le loro imperfezioni e tendenze, che si ritrovano molto spesso negli stessi prodotti e implementazioni d’intelligenza artificiale (attraverso i modelli usati per il training, ad esempio). Oltre, ovviamente, ai limiti “fisici” della tecnologia attualmente disponibile.

Pensare che queste tecnologie, così imperfette, stanno invadendo tutti i nostri spazi pubblici e privati, raccogliendo dati e analizzando, in modo automatico, i nostri comportamenti, volti, espressioni e altri dati biometrici, mi preoccupa. Anche alla luce di preoccupanti novità normative, come quella recentemente approvata dall’Unione Europea sul controllo automatico di tutte le conversazioni in Rete per “combattere la pedopornografia” (obiettivo lodevole ma mi preoccupa la pesante invasività nelle comunicazioni riservate di milioni di liberi e innocenti cittadini): dove è il confine, dove tracciamo la linea per stabilire fino a dove la tecnologia può arrivare e dove, invece, è meglio che a decidere sia un essere umano, con tutti i suoi “difetti” chiamati anche “umanità”?